热门文章

- Bootstrap安装教程 (发布时间:2021-06-25 17:03:51)

- bootstrap框架怎么用?10分钟教你学会使用bootstrap开发网页 (发布时间:2021-06-25 16:32:17)

- Bootstrap5 出来了,我应该学习Bootstrap4还是Bootstrap5? (发布时间:2021-05-02 13:21:53)

最新文章

- 前端开发框架bootstrap5中bootstrap.min.css bootstrap.rtl.min.css bootstrap-utilities.min.css 的区别是什么? (发布时间:2026-02-14 16:57:40)

- 前端开发框架bootstrap5中 bootstrap.min.js bootstrap.bundle.min.js bootstrap.esm.min.js 三个文件的区别是什么 (发布时间:2026-02-14 16:56:35)

- 我通过重新学习 HTML 学到的东西 (发布时间:2021-06-30 17:37:25)

- 设计师:注意你的语言 (发布时间:2021-06-30 17:28:00)

- 设计全方位搜索 (发布时间:2021-06-30 17:12:41)

- CSS 垂直媒体查询的用例 (发布时间:2021-06-30 17:05:47)

- 世界上最受欢迎的排版博客现在有一家商店 (发布时间:2021-06-30 17:05:31)

- 每天学习前端 Web 开发的旅程 (发布时间:2021-06-30 16:31:02)

- Bootstrap安装教程 (发布时间:2021-06-25 17:03:51)

- bootstrap框架怎么用?10分钟教你学会使用bootstrap开发网页 (发布时间:2021-06-25 16:32:17)

Python手拉手教你爬取贝壳房源数据的实战教程

发布时间:2021-06-25 16:32:17

一、爬虫是什么?

在进行大数据分析或者进行数据挖掘的时候,数据源可以从某些提供数据统计的网站获得,也可以从某些文献或内部资料中获得,但是这些获得数据的方式,有时很难满足我们对数据的需求,而手动从互联网中去寻找这些数据,则耗费的精力过大。此时就可以利用爬虫技术,自动地从互联网中获取我们感兴趣的数据内容,并将这些数据内容爬取回来,作为我们的数据源,从而进行更深层次的数据分析,并获得更多有价值的信息。 在使用爬虫前首先要了解爬虫所需的库(requests)或者( urllib.request ),该库是为了爬取数据任务而创建的。

二、使用步骤

1.引入库

代码如下(示例):

2.读入数据

代码如下 :

该处使用的url网络请求的数据。

3.随机选择一个ip地址构建代理服务器

该处除随机选择ip地址以外还会限制爬取数据的速度,避免暴力爬取。

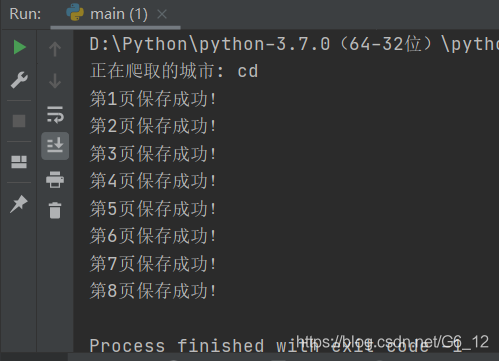

4.运行代码

运行结果就会这样,会保存在你的文件夹中。

总结

这里对文章进行总结:今天分析这波代码目的是为了让大家清晰明亮的了解python爬虫的运作,和大家一起学习

以上就是今天要讲的内容,本文仅仅简单介绍了pandas的使用,而urllib.request提供了大量能使我们快速便捷地爬取数据。